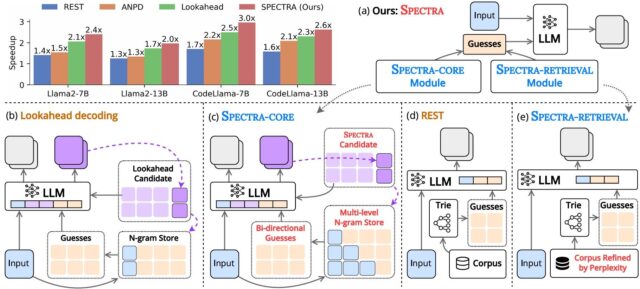

Diagrama esquemático de los espectros y otros enfoques existentes sin capacitación. Crédito: Nguyen le Minh de Jaist

La producción de alta calidad a baja latencia es un requisito crítico cuando se utilizan modelos de idiomas grandes (LLM), especialmente en escenarios del mundo real, como los chatbots que interactúan con los clientes o los asistentes de código AI utilizados por millones de usuarios diariamente.

Actualmente, los LLM usan un marco llamado decodificación autorregresiva, en la que el texto se genera un token a la vez, y el texto anterior se usa para generar la siguiente secuencia. Sin embargo, esto es claramente ineficiente, porque para secuencias más largas, el tiempo para generar respuestas aumenta linealmente.

Para abordar este problema, los investigadores están explorando ampliamente el uso de la decodificación especulativa que sigue un marco de “suposición y verificación”. En este enfoque, un LLM más pequeño y capacitado específicamente adivina múltiples tokens de texto por adelantado, que se verifica simultáneamente por el LLM original, reduciendo sustancialmente el tiempo de generación de respuesta.

Pero estos enfoques requieren capacitación modelo adicional y amplios recursos computacionales. Si bien los investigadores han considerado modelos especulativos libres de capacitación en paralelo, la ganancia de aceleración en estos enfoques sigue siendo limitada debido a una calidad reducida de sus conjeturas especulativas.

Para abordar estas brechas en el campo, el profesor Nguyen Le Minh y sus estudiantes de doctorado, Nguyen-Khang Le y Dinh-Truong, del Instituto Avanzado de Ciencia y Tecnología de Japón (JAIST) desarrollaron recientemente un nuevo marco de decodificación especulativo llamado Spectra y demostró la velocidad de generación de texto acelerada sin necesidad de capacitación adicional.

“El marco consta de dos componentes principales: un módulo de núcleo (Spectra-n-n-core), que se integra a la perfección en LLM de manera plug-and-play, y un módulo de recuperación opcional (Spectra-Retrieval) que mejora aún más el rendimiento”, explica el profesor Nguyen. Los hallazgos del equipo se presentaron en la 63ª Reunión Anual de la Asociación de Lingüística Computacional (ACL 2025) Por Dinh-Truong Truong y son publicado en las actas de la conferencia.

El núcleo de espectros, el módulo central, genera conjeturas de alta calidad mediante el uso del patrón de distribución de texto predicho por la LLM, mejorando la decodificación especulativa. En este sistema inteligente, los diccionarios que contienen diferentes tamaños de secuencias de palabras (n-gramos) pueden buscarse bidireccionalmente (hacia adelante y hacia atrás) para predecir combinaciones de palabras, adivinando frases de diferentes longitudes de forma rápida y precisa. Además, Spectra sigue optimizando los diccionarios N-Gram actualizándolos constantemente con nuevas combinaciones de palabras, asegurando una cobertura de texto robusta.

Para acelerar aún más, el módulo de recuperación, Spectra-Retrieval, se integra en el núcleo de espectros. Los enfoques existentes que utilizan fuentes externas para recuperar información y generar conjeturas en la decodificación especulativa a menudo luchan por integrarse con otros marcos de decodificación a medida que el tiempo de búsqueda excede los resultados de la aceleración.

Por el contrario, Spectra-Retrieval filtra un gran conjunto de datos de textos y mantiene solo las piezas que son fáciles de predecir para el objetivo LLM en función de los puntajes de perplejidad. Esto, a su vez, garantiza que solo los datos relevantes y de alta calidad se usen para capacitar o ajustar el modelo, lo que permite una integración perfecta con el núcleo de espectros.

En su estudio, el equipo probó espectros sobre seis tareas, incluidas conversaciones de múltiples vueltas, generación de código y razonamiento matemático, en tres familias LLM: Llama 2, Llama 3 y Codellama. Spectra alcanzó 4X ganancias de aceleración y pudo superar los métodos de decodificación especulativos no entrenados de última generación, especialmente descanso, ANPD y LookAhead.

Si bien la arquitectura general del modelo y las características del conjunto de datos determinaron las ganancias de aceleración de los métodos de decodificación especulativos, los espectros mostraron confiabilidad en una gama de modelos y conjuntos de datos, acelerando consistentemente las relaciones de aceleración.

“Al integrar nuestro módulo de núcleo de espectros plug-and-play, que aprovecha el almacenamiento de N-Gram de nivel múltiple y la búsqueda bidireccional, con el módulo de retrieval espectro refinado que selecciona señales externas de alta calidad a través de las señales externas de alta calidad, mientras que el filtrado basado en la perplejidad, pudimos lograr una velocidad sustancial (hasta 4.08 ×) tareas diversas y arquitecturas de modelos de perplejidad, mientras que los modelos originales de la calidad de la calidad de la calificación de la calificación original (estados de hasta 4.08 ×) en todas las tareas diversas y las arquitecturas de los modelos de modelos presentes. Nguyen.

Al reducir el tiempo de generación de respuesta sin necesidad de volver a entrenar LLM, Spectra ofrece una solución práctica para sistemas comerciales y de investigación que usan LLM y podrían conducir a una mayor accesibilidad y sostenibilidad de los IA de alto rendimiento a largo plazo.

Más información: Nguyen-Khang Le et al, Spectra: Inferencia más rápida del modelo de lenguaje grande con especulación interna y externa optimizada, Actas de la 63ª Reunión Anual de la Asociación de Lingüística Computacional (Volumen 1: Documentos largos) (2025). Doi: 10.18653/v1/2025.acl-long.685

Proporcionado por el Instituto Avanzado de Ciencia y Tecnología de Japón

Cita: hacia un nuevo marco para acelerar la inferencia de modelo de idioma grande (2025, 7 de agosto) Recuperado el 7 de agosto de 2025 de https://techxplore.com/news/2025-08-framework-large-language-inference.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.