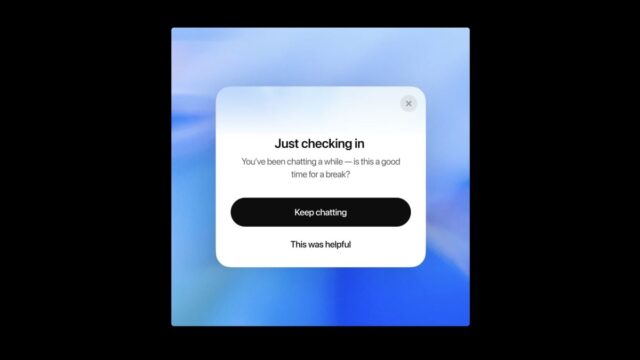

Si su rutina diaria implica chatear con frecuencia con ChatGPT, es posible que se sorprenda al ver una nueva ventana emergente esta semana. Después de una larga conversación, se le puede presentar una ventana “Just Rewing in”, con un mensaje que lee: “Has estado charlando un tiempo, ¿es un buen momento para un descanso?”

La ventana emergente le brinda la opción de “seguir chateando” o incluso seleccionar “Esto fue útil”. Dependiendo de su perspectiva, puede ver esto como un buen recordatorio para colocar la aplicación por un tiempo, o una nota condescendiente que implica que no sabe cómo limitar su propio tiempo con un chatbot.

No lo tomes personalmente: Openai puede parecer que les importan tus hábitos de uso con esta ventana emergente, pero la verdadera razón detrás del cambio es un poco más oscura que eso.

Adicto a chatgpt

Este nuevo recordatorio de uso fue parte de un mayor anuncio de Openai el lunes, titulado “Para lo que estamos optimizando chatgpt“” En la publicación, la compañía dice que valora cómo usa CHATGPT y que, si bien la compañía quiere que use el servicio, también ve un beneficio para usar menos el servicio. Parte de eso es a través de características como ChatGPT Agent, que puede tomar medidas en su nombre, pero también mediante el tiempo que pasa con CHATGPT es más efectivo y eficiente.

Eso está muy bien: si OpenAi quiere trabajar para hacer que las conversaciones de ChatGPT sean útiles para los usuarios en una fracción del tiempo, que así sea. Pero esto no viene simplemente del deseo de que los usuarios aceleren sus interacciones con ChatGPT; Más bien, es una respuesta directa a cuán adictivo puede ser el chatgpt, especialmente para las personas que confían en el chatbot para el apoyo mental o emocional.

Tampoco necesita leer entre líneas en esta. Para crédito de OpenAI, la compañía aborda directamente problemas serios que algunos de sus usuarios han experimentado con el chatbot en los últimos tiempos, incluida una actualización a principios de este año que hizo chatgpt demasiado agradable. Los chatbots tienden a ser entusiastas y amigables, pero la actualización del modelo 4O lo llevó demasiado lejos. ChatGPT confirmaría que todas sus ideas, buenas, malas o horribles, eran válidas. En el peor de los casos, el bot ignoró signos de ilusión y se alimentó directamente de la perspectiva deformada de esos usuarios.

Operai reconoce directamente que esto sucedió, aunque la compañía cree que estas instancias fueron “raras”. Aún así, están atacando directamente el problema: además de estos recordatorios de tomar un descanso de ChatGPT, la compañía dice que está mejorando los modelos para buscar signos de angustia, así como mantenerse alejados de responder problemas complejos o difíciles, como “¿Debo romper con mi pareja?” Operai dice que incluso está colaborando con expertos, médicos y profesionales médicos de varias maneras para hacerlo.

Todos deberíamos usar AI un poco menos

Definitivamente es bueno que Operai quiera que uses menos Chatgpt, y que están reconociendo activamente sus problemas y trabajando para abordarlos. Pero no creo que sea suficiente para confiar en Openai aquí. Lo mejor para la empresa no siempre será lo que sea lo mejor para su mejor interés. Y, en mi opinión, todos podríamos beneficiarnos de pasar de la IA generativa.

¿Qué piensas hasta ahora?

A medida que más y más personas recurren a los chatbots para obtener apoyo con el trabajo, las relaciones o su salud mental, es importante recordar que estas herramientas no son perfectas o incluso se entienden totalmente. Como vimos con GPT-4O, los modelos de IA pueden ser defectuosos y decidir comenzar a alentar formas peligrosas de pensar. Los modelos de IA también pueden alucinar o, en otras palabras, inventar las cosas por completo. Puede pensar que la información que su chatbot le brinda es 100% precisa, pero puede estar plagada de errores o falsedades directas; a menudo, ¿está revisando sus hechos conversaciones?

Confiar en la IA con sus pensamientos privados y personales también representa un riesgo de privacidad, ya que compañías como OpenAI almacenan sus chats, y no tienen ninguna de las protecciones legales que realiza un profesional médico o representante legal con licencia. Agregando a eso, Los estudios emergentes sugieren que cuanto más confiamos en la IA, menos dependemos de nuestras propias habilidades de pensamiento crítico. Si bien puede ser demasiado hiperbólico decir que la IA nos está haciendo “más tonta”, me preocuparía la cantidad de poder mental que estamos subcontratando a estos nuevos bots.

Los chatbots no son terapeutas con licencia; Tienden a inventar las cosas; Tienen pocas protecciones de privacidad; E incluso pueden fomentar el pensamiento del engaño. Es genial que Operai quiera que uses menos ChatGPT, pero es posible que queramos usar estas herramientas incluso menos que eso.

Divulgación: la empresa matriz de Lifehacker, Ziff Davis, presentó una demanda contra Operai en abril, alegando que infringió los derechos de autor de Ziff Davis en la capacitación y la operación de sus sistemas de IA.