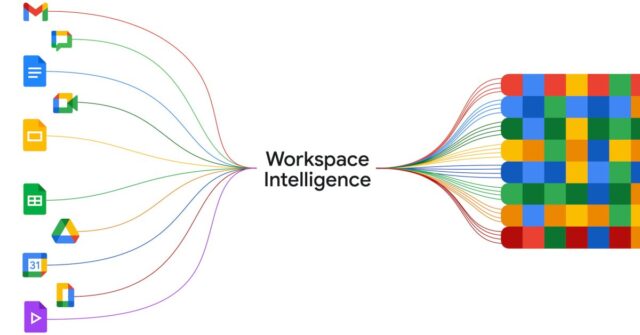

En Cloud Next 2026, Google anunció hoy “Workspace Intelligence” para proporcionar “un contexto personalizado y altamente preciso para cada aplicación”.

Este sistema “comprende relaciones semánticas complejas” entre los datos de Gmail, Docs y otras aplicaciones de Workspace, sus proyectos activos, colaboradores y otra información específica de la empresa. Workspace Intelligence utiliza las capacidades de búsqueda de Google y el razonamiento avanzado de Gemini para:

Recopilación de información: Workspace Intelligence se encarga del trabajo pesado recopilando la información adecuada para usted. Derriba los muros de contexto para garantizar que tengas todo lo que necesitas en el momento en que quieras actuar. Conciencia de la situación: mediante el razonamiento avanzado de Gemini, Workspace Intelligence sabe qué es lo más importante para usted en este momento, lo que garantiza que nunca se pierda una acción. Personalización verdadera: al comprender su trabajo anterior y sus patrones de comunicación, Workspace Intelligence aprende su estilo de trabajo, voz y preferencias de formato únicos para garantizar que cada salida suene auténticamente como usted.

Al aprovechar el contexto semántico profundo de sus flujos de trabajo digitales que abarcan notas de reuniones, correos electrónicos, archivos y más, crea una capa de inteligencia basada en su contexto único que puede cambiar fundamentalmente su forma de trabajar.

Esta capa de fondo potencia funciones como AI Inbox y AI Overviews en Gmail. Workspace Intelligence también es responsable de nuevas capacidades como “Preguntar a Gemini” en Google Chat. Esta conversación dedicada con Gemini se posiciona como una “línea de comando unificada para todo su trabajo”.

Simplemente indique su objetivo y Gemini trabajará detrás de escena para entregar el resultado final directamente en su chat.

Ask Gemini in Chat puede realizar las tareas complejas que usted le encomiende, incluida la generación de documentos y diapositivas, la búsqueda de archivos basada en descripciones y la búsqueda de los horarios adecuados para las reuniones según el horario de todos. También puede crear un resumen diario e integrarse con herramientas de terceros, como Asana, Jira y Salesforce.

Anuncio: desplácese para ver más contenido

En Google Docs, Gemini puede utilizar Workspace Intelligence para crear infografías “basadas en los datos de su empresa”. Puede editar varias imágenes simultáneamente “para crear coherencia visual en todo el documento”. Otra capacidad puede “clasificar y responder a los comentarios de sus documentos, e incluso editar su documento basándose en los comentarios”.

Gemini en Google Slides aprovecha Workspace Intelligence para brindar contexto y cumplimiento estricto de “las plantillas y estilos visuales de su empresa” al generar presentaciones de diapositivas de una sola vez. En Google Sheets, se utiliza para crear y editar hojas de cálculo de forma conversacional.

Workspace Intelligence recupera sus correos electrónicos, chats, archivos e información relevantes de la web para transformar ideas en borradores con formato profesional que imitan exactamente su voz, marca, estilo y plantillas de empresa.

La decisión de denominar explícitamente “Workspace Intelligence”, en lugar de simplemente posicionar la funcionalidad como una extensión de Gemini, es interesante. Dicho esto, esta capa finalmente funcionará en segundo plano y es algo de lo que los usuarios finales no tienen que estar conscientes.

Google también anunció la octava generación de Unidades de Procesamiento Tensoriales. Este año cabe destacar la introducción de “dos arquitecturas distintas y diseñadas específicamente para entrenamiento e inferencia”.

TPU 8t (izquierda) es para entrenamiento con el objetivo de reducir el “ciclo de desarrollo del modelo de frontera de meses a semanas”. Ofrece una relación precio/rendimiento 2,8 veces mejor que la última generación. Las características incluyen:

Escala masiva: un único superpod TPU 8t ahora escala a 9600 chips y dos petabytes de memoria compartida de alto ancho de banda, con el doble de ancho de banda entre chips que la generación anterior. Esta arquitectura ofrece 121 ExaFlops de computación y permite que los modelos más complejos aprovechen un único y masivo conjunto de memoria. Máxima utilización: al integrar también un acceso al almacenamiento 10 veces más rápido, combinado con TPUDirect para extraer datos directamente a la TPU, TPU 8t ayuda a garantizar la máxima utilización del sistema de extremo a extremo. Escalado casi lineal: nuestra nueva red Virgo, combinada con JAX y nuestro software Pathways, significa que TPU 8t proporciona un escalado casi lineal para hasta un millón de chips en un único clúster lógico.

Mientras tanto, TPU 8i (derecha) es para inferencia o ejecución de modelos. Proporciona un rendimiento por dólar un 80% mejor que antes, lo que, según Google, se traduce en que las empresas pueden “atender casi el doble del volumen de clientes al mismo costo”.

Rompiendo el “muro de la memoria”: para evitar que los procesadores permanezcan inactivos, TPU 8i combina 288 GB de memoria de alto ancho de banda con 384 MB de SRAM en el chip (3 veces más que la generación anterior) manteniendo el conjunto de trabajo activo de un modelo completamente en el chip. Eficiencia impulsada por Axion: duplicamos los hosts de CPU físicos por servidor y pasamos a nuestras CPU personalizadas basadas en Axion Arm. Al utilizar una arquitectura de memoria no uniforme (NUMA) para el aislamiento, hemos optimizado todo el sistema para lograr un rendimiento superior. Ampliación de modelos MoE: para los modelos modernos de combinación de expertos (MoE), duplicamos el ancho de banda de interconexión (ICI) a 19,2 Tb/s. Nuestra nueva arquitectura Boardfly reduce el diámetro máximo de la red en más del 50%, lo que garantiza que el sistema funcione como una unidad cohesiva y de baja latencia. Eliminación del retraso: nuestro nuevo motor de aceleración colectiva (CAE) en el chip descarga las operaciones globales, reduciendo la latencia en el chip hasta 5 veces, minimizando el retraso.

Nota: Google Cloud patrocinó los costos de alojamiento, pero no participó en la cobertura editorial.

FTC: Utilizamos enlaces de afiliados automáticos que generan ingresos. Más.