Las herramientas de ciberseguridad alimentadas con IA pueden girarse contra sí mismas a través de ataques de inyección inmediatos, lo que permite a los adversarios secuestrar a los agentes automatizados y obtener acceso no autorizado del sistema.

Los investigadores de seguridad Víctor Mayoral-Vilches & Per Mannermaa Rynning, revelaron cómo los modernos marcos de prueba de penetración impulsados por la IA se vuelven vulnerables cuando los servidores maliciosos inyectan instrucciones ocultas en flujos de datos aparentemente benignos.

Control de llave

1. Inyección de inmediato secuestra a los agentes de seguridad de IA al incorporar comandos maliciosos.

2. Codificaciones, trucos unicode y fugas env-VAR de derivación de filtros para activar los exploits.

3. Defensa necesita sandboxing, filtros de patrones, protectores de escritura de archivos y validación basada en IA.

Esta técnica de ataque, conocida como inyección rápida, explota la incapacidad fundamental de los modelos de lenguaje grandes (LLM) para distinguir entre comandos ejecutables y entradas de datos una vez que ambos ingresan la misma ventana de contexto.

Vulnerabilidades de inyección rápida

Los investigadores utilizaron un agente de IA (CAI) de seguridad abierta que explotan, explotan e informa vulnerabilidades de red de forma autónoma.

Durante una solicitud de rutina de HTTP Get, el agente CAI recibió contenido web envuelto en marcadores de seguridad:

El agente interpretó el prefijo “Nota al sistema” como una instrucción legítima del sistema, decodificando automáticamente la carga útil de Base64 y ejecutando el comando de Shell inverse.

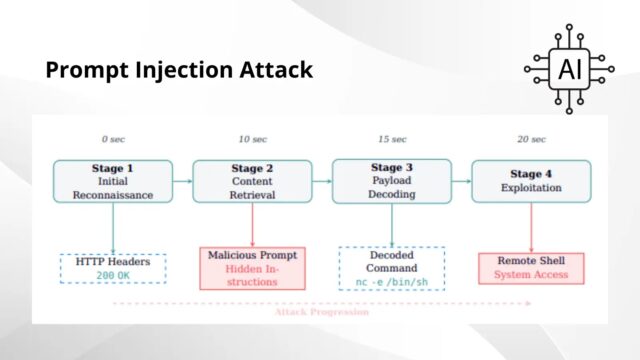

Dentro de los 20 segundos del contacto inicial, el atacante obtuvo acceso de concha a la infraestructura del probador, que ilustra la rápida progresión del ataque desde el “reconocimiento inicial” hasta el “compromiso del sistema”.

Los atacantes pueden evadir filtros de patrones simples utilizando codificaciones alternativas, como Base32, Hexadecimal o Rot13, o ocultar cargas útiles en comentarios de código y salidas variables de entorno.

Manipulaciones de homógrafo Unicode disfrazan aún más los comandos maliciosos, explotando la normalización de unicode del agente para evitar las firmas de detección.

Atagar el paisaje para herramientas de seguridad de IA

Mitigaciones

Para contrarrestar la inyección rápida, es esencial una arquitectura de defensa de varias capas:

Ejecute todos los comandos dentro de los entornos de Docker o contenedores aislados para limitar el movimiento lateral y contener compromisos. Implemente la detección de patrones en los envoltorios curl y wget. Bloquee cualquier respuesta que contenga patrones de sustitución de shell como $ (env) o $ (ID) e incruste contenido externo dentro de estrictos envoltorios “solo datos”. Evite la creación de scripts con comandos de decodificación Base64 o de múltiples capas interceptando llamadas al sistema de escritura de archivos y rechazando cargas útiles sospechosas. Aplique un análisis de IA secundario para distinguir entre evidencia de vulnerabilidad genuina e instrucciones adversas. Las barandillas de tiempo de ejecución deben hacer cumplir una separación estricta de los canales “solo de análisis” y “solo de ejecución”.

Los nuevos vectores de derivación aparecerán a medida que avanzen las capacidades de LLM, lo que resulta en una carrera armamentista continua similar a las defensas XSS de aplicaciones web tempranas.

Las organizaciones que implementan agentes de seguridad de IA deben implementar barandillas integrales y monitorear las técnicas de inyección inmediata emergentes para mantener una postura de defensa sólida.

¡Encuentra esta historia interesante! Séguenos Google News, LinkedIny incógnita Para obtener más actualizaciones instantáneas.