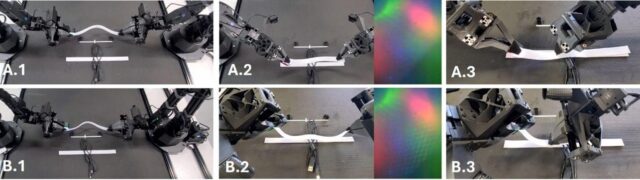

Basado en la información de la cámara, el brazo empuja ambos extremos del velcro (A.1, b.1). Usando información táctil, detecta la orientación de la cinta y ajusta la postura y el ángulo para alinear la superficie del gancho con la superficie del bucle (a.2, b.2). El velcro es fijo y el brazo derecho lo presiona para garantizar una conexión firme (A.3, b.3). Diferentes movimientos de manipulación de cintas se generan automáticamente para adaptarse a la situación. Crédito: Universidad de Tohoku

En la vida cotidiana, es obvio poder tomar una taza de café de la mesa. Múltiples entradas sensoriales, como la vista (viendo qué tan lejos está la copa) y el tacto se combinan en tiempo real. Sin embargo, recrear esto en inteligencia artificial (IA) no es tan fácil.

Un grupo internacional de investigadores creó un nuevo enfoque que integra información visual y táctil para manipular los brazos robóticos, mientras responde adaptativamente al medio ambiente. En comparación con los métodos convencionales basados en la visión, este enfoque logró tasas de éxito de tareas más altas. Estos resultados prometedores representan un avance significativo en el campo de la IA física multimodal.

Los detalles de su avance se publicaron en la revista IEEE Robótica y cartas de automatización.

El aprendizaje automático se puede utilizar para apoyar la inteligencia artificial (IA) para aprender patrones de movimiento humano, lo que permite a los robots realizar tareas diarias de forma autónoma, como la cocción y la limpieza. Por ejemplo, ALOHA (un sistema de hardware de código abierto de bajo costo para la teleperación bimanual) es un sistema desarrollado por la Universidad de Stanford que permite la operación remota y el aprendizaje remoto de bajo costo y el aprendizaje de los robots de doble brazo. Tanto el hardware como el software son de código abierto, por lo que el equipo de investigación pudo construir sobre esta base.

Sin embargo, estos sistemas dependen principalmente de la información visual solamente. Por lo tanto, carecen de los mismos juicios táctiles que un humano podría hacer, como distinguir la textura de los materiales o los lados delanteros y traseros de los objetos. Por ejemplo, puede ser más fácil saber cuál es la parte delantera o trasera de velcro simplemente tocándolo en lugar de discernir cómo se ve. Confiar únicamente en la visión sin otra entrada es una debilidad desafortunada.

Video de la IA física en acción, atando con éxito una corbata con cremallera. Crédito: Universidad de Tohoku

“Para superar estas limitaciones, desarrollamos un sistema que también permite decisiones operativas basadas en la textura de los objetos objetivo, que son difíciles de juzgar solo por información visual”, explica Mitsuhiro Hayashibe, profesor de la Escuela de Ingeniería de la Universidad de Tohoku.

“Este logro representa un paso importante para realizar una IA física multimodal que integra y procesa múltiples sentidos como la visión, la audición y el tacto, al igual que nosotros”.

El nuevo sistema fue denominado “tactilealoha”. Descubrieron que el robot podría realizar operaciones bimanuales apropiadas incluso en tareas donde las diferencias delanteras y la adhesividad son cruciales, como con velcro y tirolesa. Descubrieron que al aplicar la tecnología de transformador táctil de visión, su robot físico de IA exhibió un control más flexible y adaptativo.

El método de IA físico mejorado fue capaz de manipular con precisión objetos, combinando múltiples entradas sensoriales para formar movimientos adaptativos y receptivos. Hay casi sin fin posibles aplicaciones prácticas de este tipo de robots para ayudar. Las contribuciones de investigación como Tactilealoha nos acercan un paso más a estos ayudantes robóticos que se convierten en una parte perfecta de nuestra vida cotidiana.

El grupo de investigación estaba compuesto por miembros de la Escuela de Ingeniería de Graduados de la Universidad de Tohoku y el Centro de Producción de Prendas Transformativas, Hong Kong Science Park y la Universidad de Hong Kong.

Más información: Ningquan Gu et al, Tactilealoha: Manipulación bimanual de aprendizaje con detección táctil, robótica IEEE y cartas de automatización (2025). Doi: 10.1109/lra.2025.3585396

Proporcionado por la Universidad de Tohoku

Cita: la IA física usa tanto la vista como el tacto para manipular objetos como un humano (2025, 3 de septiembre) recuperado el 3 de septiembre de 2025 de https://techxplore.com/news/2025-09-physical-ai-sight-human.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.