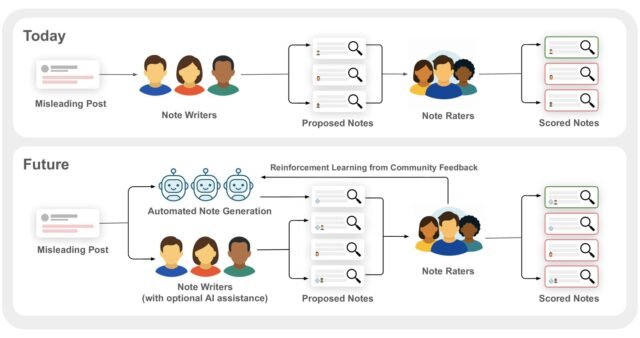

Una expansión del canal de notas de la comunidad de “todo humano” a un modelo híbrido “humano-llm”. Hoy (arriba): los escritores de notas humanas redactan las notas propuestas en respuesta a una publicación engañosa, y otros contribuyentes humanos califican su ayuda; El algoritmo de puente elige las notas ampliamente útiles. Futuro (abajo): LLMS también participará en la etapa de escritura, produciendo notas o ayudando a escritores humanos, mientras que la etapa de calificación sigue siendo solo para humanos. Los comentarios de la comunidad de los evaluadores humanos fluyen para mejorar la generación de notas LLM (RLCF). Crédito: ARXIV (2025). Doi: 10.48550/arxiv.2506.24118

X (anteriormente Twitter) lanzó su programa “Notas comunitarias” en 2021 para combatir la información errónea al permitir a los usuarios agregar notas contextuales en las publicaciones que podrían ser engañosas o conducir a una interpretación errónea. Un ejemplo sería los usuarios que etiquetaron un video generado por IA como tal, para que otros usuarios no sean engañados para creer que el evento en el video realmente ocurrió. La comunidad descentralizada de las redes sociales califica las notas comunitarias para determinar su utilidad. Solo las notas determinadas útiles por los evaluadores se muestran en la publicación. La comunidad de X notas luego inspiró a otras plataformas a lanzar programas similares.

Hasta este punto, estos sistemas de verificación de hechos basados en la comunidad consistían completamente en notas generadas por humanos y evaluadores humanos. Sin embargo, X ahora está pilotando un nuevo programa, lo que permite la IA, en forma de grandes modelos de aprendizaje (LLM), generar notas comunitarias junto con los humanos.

El modelo propuesto, publicado Recientemente por investigadores X, integra las notas humanas y de IA en la tubería, pero aún solo permite que los humanos determinen qué notas son útiles. En una era de desinformación desagradable, los investigadores creen que es necesaria la velocidad y escala de las notas generadas por LLM. Escriben: “Permitir la creación de notas automatizadas permitiría que el sistema funcione a una escala y velocidad que es imposible para los escritores humanos, lo que puede proporcionar un contexto para los pedidos de magnitud más contenido en toda la web”.

La generación de notas LLM mejorará aún más al aprender de los comentarios de la comunidad en un proceso denominado aprendizaje de refuerzo de la retroalimentación de la comunidad (RLCF). Este proceso está destinado a refinar la generación de notas futuras a través de una amplia gama de comentarios de los miembros de la comunidad con una variedad de puntos de vista y se espera que resulte en notas más precisas, imparciales y útiles.

Una agenda de investigación para las notas comunitarias con alimentación de LLM. (1) LLMS personalizados para la generación de notas; (2) ‘copilotos’ de AI para escritores humanos; (3) asistencia de IA para evaluadores humanos; (4) Nota inteligente ‘coincidencia’ adapta las notas útiles existentes a contextos nuevos y similares; (5) evolucionar el algoritmo central para el contenido generado por IA; (6) Construir una infraestructura robusta y abierta. Crédito: ARXIV (2025). Doi: 10.48550/arxiv.2506.24118

Aunque se espera que el nuevo modelo mejore el proceso de verificación de información errónea en general, existen algunos riesgos potenciales. Los investigadores notan problemas potenciales con notas generadas por IA que son persuasivas e inexactas, un problema conocido con otros modelos, y un riesgo de notas excesivas. También hay cierta preocupación de que los escritores de notas humanas puedan participar con menos frecuencia, debido a la abundancia de notas generadas por IA, y que esta abundancia podría abrumar la capacidad de los evaluadores humanos para determinar lo suficiente qué es útil y qué no.

El estudio también analiza muchas posibilidades futuras que involucran aún más integración de IA en la tubería de notas comunitarias, al tiempo que mantienen los controles humanos en su lugar. Las instrucciones futuras pueden implicar la integración de los copilotos de IA para que los escritores humanos realicen investigaciones y publiquen más notas más rápidas y de asistencia A-AI-A-Ayer para ayudar a los evaluadores humanos a auditar las notas de manera más eficiente. Los investigadores también proponen métodos de verificación y autenticación para evaluar a los evaluadores y escritores humanos, la personalización de LLM y métodos para adaptar y volver a aplicar notas ya validadas a contextos similares, de modo que los evaluadores no califican los mismos conceptos una y otra vez.

Existe el potencial de estos métodos de colaboración Human-AI, con los humanos que proporcionan matices y diversidad y LLM que proporcionan la velocidad y la escala para lidiar con la abundancia de información disponible en línea, pero todavía hay una gran cantidad de pruebas para garantizar que el toque humano no se pierda. Los autores del estudio describen su objetivo final al decir: “El objetivo no es crear un asistente de IA que les diga a los usuarios qué pensar, sino construir un ecosistema que capacite a los humanos a pensar de manera más crítica y comprender mejor el mundo”.

Escrito para usted por nuestro autor Crystal Kasaleditado por Andrew Zinin—Este artículo es el resultado de un trabajo humano cuidadoso. Confiamos en lectores como usted para mantener vivo el periodismo científico independiente. Si este informe le importa, considere un donación (especialmente mensual). Obtendrá una cuenta sin anuncios como agradecimiento.

Más información: Haiwen Li et al, Escalando el juicio humano en notas comunitarias con LLMS, ARXIV (2025). Doi: 10.48550/arxiv.2506.24118

Información en el diario: ARXIV

© 2025 Science X Network

Cita: el programa piloto integra notas generadas por IA con Notas de la comunidad humana en la plataforma X (2025, 4 de julio) Recuperado el 4 de julio de 2025 de https://techxplore.com/news/2025-07-AI-AI-Human-Community-platform.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.