Los investigadores de la Universidad de Sophia descubren que tanto el volumen como las señales acústicas basadas en la frecuencia ayudan a los oyentes a identificar la dirección de enfrentamiento del altavoz, un avance para el audio espacial en realidades virtuales y aumentadas. Crédito: Dra. Shinya Tsuji, Universidad de Sophia, Japón

A medida que la tecnología integra cada vez más paisajes sonoros complejos en espacios virtuales, comprender cómo los humanos perciben el audio direccional se vuelve vital. Esta necesidad se ve reforzada por el surgimiento de medios inmersivos, como la realidad aumentada (AR) y la realidad virtual (VR), donde los usuarios son virtualmente transportados a otros mundos. En un estudio reciente, los investigadores exploraron cómo los oyentes identifican la dirección desde la que enfrenta un orador mientras habla.

La investigación fue dirigida por la Dra. Shinya Tsuji, miembro postdoctoral, Sra. Haruna Kashima y el profesor Takayuki Arai del Departamento de Ciencias de la Información y la Comunicación, Universidad de Sophia, Japón. El equipo también incluyó al Dr. Takehiro Sugimoto, el Sr. Kotaro Kinohita y el Sr. Yasushige Nakayama de los Laboratorios de Investigación de Ciencia y Tecnología de NHK, Japón. Su estudio fue publicado En la revista Acoustical Science and Technology.

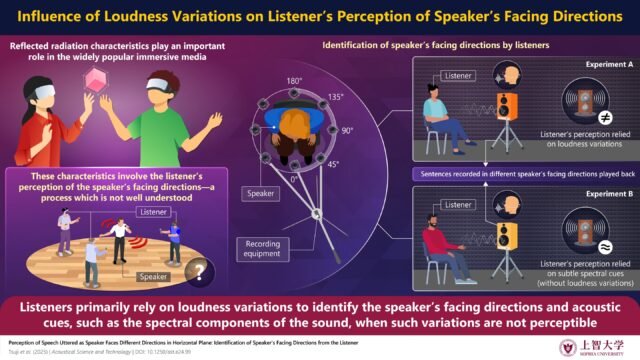

En el estudio, los investigadores pidieron a los participantes que identificaran la dirección que enfrentaba un altavoz utilizando solo grabaciones de sonido, utilizando dos experimentos. El primer experimento incluyó grabaciones de sonido con variaciones en el volumen, y el segundo experimento implicó grabaciones con volumen constante.

Los investigadores descubrieron que el volumen era consistentemente un fuerte indicador para juzgar la dirección de frente del altavoz, pero cuando se minimizaban las señales de volumen, los oyentes aún lograron hacer juicios correctos basados en las señales espectrales del sonido. Estas señales espectrales implican la distribución y la calidad de las frecuencias de sonido que cambian sutilmente dependiendo de la orientación del altavoz.

“Nuestro estudio sugiere que los humanos confían principalmente en el volumen para identificar la dirección de frente de un hablante”, dijo el Dr. Tsuji. “Sin embargo, también se puede juzgar por algunas señales acústicas, como el componente espectral del sonido, no solo el volumen solo”.

Estos hallazgos son particularmente útiles en los campos de sonido virtuales que permiten seis grados de libertad, entornos inmersivos como los que se encuentran en las aplicaciones AR y VR, donde los usuarios pueden moverse libremente y experimentar audio en diferentes configuraciones espaciales.

“En el contenido que tiene campos de sonido virtuales con seis grados de libertad, como AR y VR, donde los oyentes pueden apreciar libremente los sonidos de varias posiciones, la experiencia de las voces humanas puede mejorarse significativamente utilizando los hallazgos de nuestra investigación”, dijo el Dr. Tsuji.

La investigación surge en un momento en que el audio inmersivo es una importante frontera de diseño para las empresas de tecnología de consumo. Dispositivos como Meta Quest 3 y Apple Vision Pro ya están cambiando la forma en que las personas interactúan con los espacios digitales. La representación precisa de las voces humanas en estos entornos puede elevar significativamente la experiencia del usuario, ya sea en entretenimiento, educación o comunicación.

“AR y VR se han vuelto comunes con los avances en tecnología”, agregó el Dr. Tsuji. “A medida que se desarrolla más contenido para estos dispositivos en el futuro, los hallazgos de nuestro estudio pueden contribuir a tales campos”.

Más allá de las aplicaciones inmediatas, esta investigación tiene implicaciones más amplias en cómo podríamos construir paisajes sonoros más intuitivos y receptivos en el mundo digital. Al mejorar el realismo a través del audio, las empresas pueden crear medios inmersivos más convincentes, un factor importante no solo para el entretenimiento, sino también para las soluciones de accesibilidad, reuniones virtuales e intervenciones terapéuticas.

Al descubrir el papel de la volumen y las señales espectrales en la direccionalidad basada en la voz, este estudio profundiza nuestra comprensión de la percepción auditiva y establece una base para la próxima generación de sistemas de audio espacial. Los hallazgos allanan el camino para diseñar interacciones virtuales más realistas, particularmente aquellas que involucran el habla humana, que es probablemente el sonido más familiar y significativo que procesamos todos los días.

Más información: Shinya Tsuji et al, la percepción del habla pronunciada cuando el hablante enfrenta diferentes direcciones en el plano horizontal: identificación de las direcciones de oradores del oyente, ciencia acústica y tecnología (2024). Dos: 10.1250/AST.E24.99

Proporcionado por la Universidad de Sophia

Cita: Escuche aquí: Cómo las señales de volumen y acústica nos ayudan a juzgar dónde enfrenta un orador (2025, 1 de julio) Recuperado el 1 de julio de 2025 de https://techxplore.com/news/2025-07-loudness-coustic-cues-speaker.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.