Teherán – En el pasado, el dicho “Ver es creer” llevó peso. Una fotografía o un video se consideró una prueba de realidad. Pero en la era digital actual, incluso nuestros ojos pueden engañarnos.

Gracias al rápido desarrollo de la inteligencia artificial, particularmente la tecnología de ficción profunda, las imágenes, los videos e incluso las voces ahora se pueden fabricar de manera tan convincente que distinguir los hechos de la ficción se vuelve casi imposible. Este cambio tecnológico nos está obligando a cuestionar no solo lo que vemos en línea, sino también cómo puede afectar la confianza, la democracia y la estabilidad social.

Se crean defectos profundos utilizando modelos AI avanzados que pueden aprender a replicar caras, voces y movimientos humanos con una precisión sorprendente. Al principio, esta tecnología parecía una novedad entretenida. Las plataformas de redes sociales se inundaron con clips humorísticos de celebridades cantando canciones que nunca interpretaron o actores que aparecieron en los roles que nunca jugaron. Pero debajo del humor se encuentra una realidad mucho más oscura. Cuando se arman los defectos profundos, pueden difundir la información errónea, la reputación de daños e incluso influir en los resultados políticos.

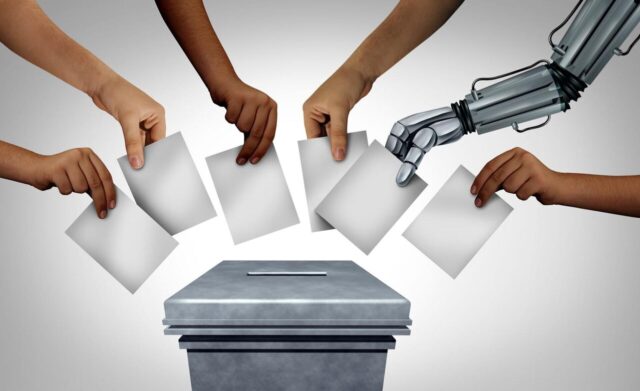

El peligro de Deepfakes es más evidente en la arena política. Imagine un video de un líder mundial que anuncia acción militar o concediendo la derrota en una elección, compartida ampliamente antes de que los verificadores de hechos puedan responder. En un entorno polarizado donde la información errónea ya se extiende más rápido que la verdad, tales fabricaciones podrían provocar pánico, disturbios o incluso conflictos. Las elecciones de 2024 en varios países ya han sido testigos de crecientes preocupaciones sobre los medios manipulados, y las apuestas solo aumentarán a medida que la tecnología se vuelva más barata y más accesible.

El problema se extiende más allá de la política. Las personas también están en riesgo, ya que los defectos se pueden usar para el acoso, el chantaje o el robo de identidad. Un video falso convincente puede arruinar la reputación de una persona en minutos, mucho antes de tener la oportunidad de defenderse. Para los periodistas y los medios de comunicación, el desafío es aún mayor. Si se puede cuestionar la autenticidad de cada foto o video, ¿cómo mantenemos la confianza en los medios como fuente de verdad? Esta erosión de la confianza es quizás la consecuencia más insidiosa de Deepfakes. Crea una atmósfera en la que las personas pueden descartar verdades inconvenientes como “falsas”, mientras que las mentiras maliciosas ganan tracción.

Sin embargo, como con la mayoría de las tecnologías, los profundos no son inherentemente malvados. Las mismas herramientas que pueden engañar también se pueden usar para la creatividad y el progreso. En la producción cinematográfica, la tecnología Deepfake reduce los costos al permitir efectos realistas sin reorgiros costosos. En educación, las figuras históricas pueden traerse “de vuelta a la vida” para involucrar a los estudiantes. En medicina, las reconstrucciones faciales impulsadas por la IA pueden ayudar a los pacientes a recuperarse del trauma. Estos ejemplos nos recuerdan que la tecnología en sí es neutral: es cómo elegimos usarla que define su impacto.

Abordar los riesgos éticos y sociales de los defensores profundos requiere un enfoque de múltiples capas. Las empresas de tecnología ya están desarrollando herramientas de detección para identificar contenido manipulado. Sin embargo, la carrera entre los creadores y detectores de Deepfake es constante, y a menudo las falsificaciones se extienden más rápido que la verdad. Los marcos legales también están comenzando a evolucionar, pero las leyes luchan por mantener el ritmo de la velocidad de la innovación. Lo más importante es que la alfabetización digital entre el público es crítica. Los ciudadanos deben aprender a cuestionar lo que ven en línea, verificar la información de múltiples fuentes y resistir el impulso de compartir contenido sensacional sin escrutinio.

En esencia, el debate de Deepfake no se trata solo de tecnología sino de confianza. En las sociedades democráticas, la confianza es el pegamento que mantiene unas instituciones, confianza en las elecciones, en periodismo, en líderes y entre sí.

Si esa confianza se derrumba bajo el peso de las realidades fabricadas, las consecuencias podrían ser graves. Al mismo tiempo, descartar a Deepfakes como puramente destructivos ignora las oportunidades que brindan para el arte, la educación y la innovación.

Ahora nos paramos en una encrucijada. Los defectos profundos se convierten en otro arma en el arsenal de la desinformación, o la sociedad aprende a adaptarse, creando salvaguardas y cultivando la resiliencia. El futuro dependerá no solo de nuevas tecnologías para detectar las falsificaciones, sino también de nuestra capacidad colectiva para seguir siendo críticos, reflexivos y responsables de la información. En una época en la que ya no se cree, tal vez el verdadero desafío es construir nuevas formas de confianza que se profundicen que las imágenes y los videos.