¿Sabía que puede personalizar Google para filtrar la basura? Tome estos pasos para obtener mejores resultados de búsqueda, incluida la agregar mi trabajo en Lifehacker como fuente preferida.

Nunca debe asumir lo que le dice a un chatbot es privado. Cuando interactúa con una de estas herramientas, la compañía detrás de ella probablemente raspa los datos de la sesión, a menudo usándolos para entrenar los modelos de IA subyacentes. A menos que opte explícitamente por no participar en esta práctica, probablemente haya capacitado involuntariamente muchos modelos en su tiempo usando AI.

Anthrope, la compañía detrás de Claude, ha adoptado un enfoque diferente. La política de privacidad de la empresa ha declarado que Anthrope no recopila entradas o salidas de los usuarios para entrenar a Claude, a menos que informe el material a la empresa o opte por la capacitación. Si bien eso no significa que Anthrope se abstuviera de recopilar datos en general, podría descansar tranquilo sabiendo que sus conversaciones no estaban alimentando versiones futuras de Claude.

Eso ahora está cambiando. Según lo informado por el bordeAnthrope ahora comenzará a capacitar a sus modelos AI, Claude, en los datos del usuario. Eso significa que los nuevos chats o sesiones de codificación en las que se involucran con Claude se alimentarán a Anthrope para ajustar y mejorar las actuaciones de los modelos.

Esto no afectará las sesiones pasadas si las deja. Sin embargo, si vuelve a participar con un chat o sesiones de codificación anteriores después del cambio, Anthrope raspará los datos nuevos generados a partir de la sesión para sus fines de capacitación.

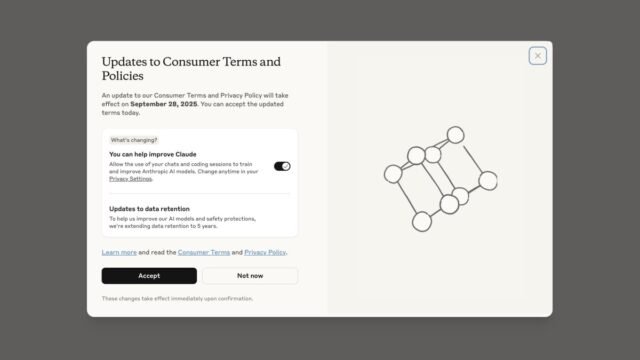

Esto no sucederá sin su permiso, al menos, no de inmediato. Anthrope está dando a los usuarios hasta el 28 de septiembre para tomar una decisión. Los nuevos usuarios verán la opción cuando configuren sus cuentas, mientras que los usuarios existentes verán una ventana emergente de permiso cuando inicie sesión. Sin embargo, es razonable pensar que algunos de nosotros haremos clic en estos menús y ventanas emergentes demasiado rápido, y accidentalmente acordamos la recopilación de datos que de otra manera no podríamos querer.

¿Qué piensas hasta ahora?

Para crédito de Anthrope, la compañía dice que intenta ocultar datos confidenciales de los usuarios a través de “una combinación de herramientas y procesos automatizados”, y que no vende sus datos a terceros. Aún así, ciertamente no quiero que mis conversaciones con IA entrenen modelos futuros. Si siente lo mismo, aquí le mostramos cómo optar por no participar.

Cómo optar por no participar en el entrenamiento antrópico de IA

Si es un usuario de Claude existente, verá una ventana emergente que advierte la próxima vez que inicie sesión en su cuenta. Esta ventana emergente, titulada “Actualizaciones de los términos y políticas del consumidor”, explica las nuevas reglas y, por defecto, lo opta a la capacitación. Para optar por no participar, asegúrese de que la alternancia al lado de “pueda ayudar a mejorar Claude” se apaga. (La alternancia se configurará hacia la izquierda con una (x), en lugar de a la derecha con una marca de verificación). Presione “Aceptar” para bloquear su elección.

Si ya ha aceptado esta ventana emergente y no está seguro si optó por esta recopilación de datos, aún puede optar por no participar. Para verificar, abra Claude y diríjase a Configuración> Privacidad> Configuración de privacidad, luego asegúrese de que la alternancia “Ayuda a mejorar Claude” esté apagada. Tenga en cuenta que esta configuración no deshacerá los datos que Anthrope ha recopilado desde que optó.