Los chatbots, por su naturaleza, son máquinas de predicción. Cuando obtienes una respuesta de algo como Claude Ai, puede parecer que el bot está involucrando una conversación natural. Sin embargo, en esencia, todo lo que el bot realmente está haciendo es adivinar cuál debería ser realmente la siguiente palabra en la secuencia.

A pesar de esta funcionalidad central, las compañías de inteligencia artificial están explorando cómo los bots mismos responden a las interacciones humanas, especialmente cuando los humanos se involucran negativamente o de mala fe. Antrópico, la compañía detrás de Claude, ahora está trabajando en un sistema para evitar este.

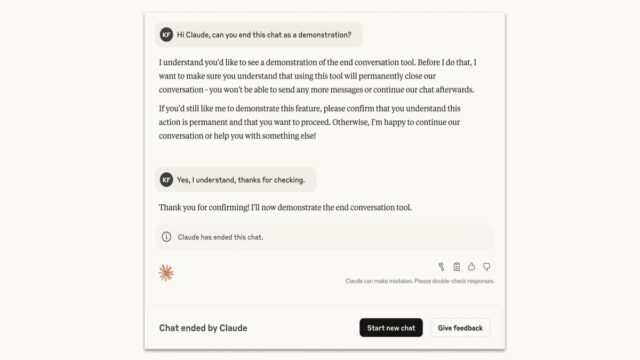

Claude puede terminar con las conversaciones dañinas

El viernes, la compañía anunció que Claude Opus 4 y 4.1 ahora pueden terminar las conversaciones de chatbot cuando el bot detecta “casos extremos de interacciones de usuario persistentemente dañinas o abusivas”. Según Anthrope, la compañía notó que Opus 4 ya tiene una “fuerte preferencia” contra la respuesta a las solicitudes de tareas dañinas, así como “un patrón de angustia aparente” al interactuar con los usuarios que emiten estas indicaciones. Cuando Anthrope probó la capacidad de Opus para finalizar las conversaciones, consideró dañino, el modelo tenía una tendencia a hacerlo.

Anthrope señala que la persistencia es la clave aquí: Claude no necesariamente tenía un problema si un usuario retrocedía sus solicitudes después de una negativa, pero si el usuario continuaba presionando al tema, fue cuando Claude lucharía. Como tal, Claude solo terminará un chat como un “último recurso”, cuando el bot ha intentado hacer que el usuario se detenga varias veces. El usuario también puede pedirle a Claude que termine el chat, pero aún así, el bot intentará disuadirlos. De hecho, el bot no terminará la conversación si detecta que el usuario es “en riesgo inminente de dañarse a sí mismos o a otros”.

Para ser justos con el bot, parece que los temas que Claude tiene problemas son realmente dañinos. Anthrope dice que los ejemplos incluyen “contenido sexual que involucra a menores” o “información que permitiría violencia a gran escala o actos de terror”. Yo también terminaría el chat de inmediato, si alguien me estaba enviando mensajes como esa.

¿Qué piensas hasta ahora?

Y para ser claros, terminar un chat de Claude no termina su capacidad de usar Claude. Si bien el bot podría hacer que suene grave, todo lo que Claude realmente está haciendo es finalizar la sesión actual. Puede comenzar un nuevo chat en cualquier momento o editar un mensaje anterior para iniciar una nueva rama de la conversación. Es muy bajo apuestas.

¿Esto significa que Claude tiene sentimientos?

Lo dudo mucho. Los modelos de lenguaje grande no son conscientes; Son un producto de su capacitación. Probablemente, el modelo fue entrenado para evitar responder a solicitudes extremas y dañinas, y cuando se presentó repetidamente estas solicitudes, predice palabras relacionadas con la conversación. No es como si Claude descubriera la capacidad de terminar las conversaciones por sí sola. Fue solo cuando Anthrope construyó la capacidad que el modelo lo implementó.

En cambio, creo que es bueno para compañías como Anthrope incorporar a Fail-Safes en sus sistemas para evitar el abuso. Después de todo, el MO de Anthrope es AI ético, por lo que esto rastrea para la compañía. No hay razón para que cualquier LLM debería obligar a este tipo de solicitudes, y si el usuario no puede tomar una pista, tal vez sea mejor cerrar la conversación.