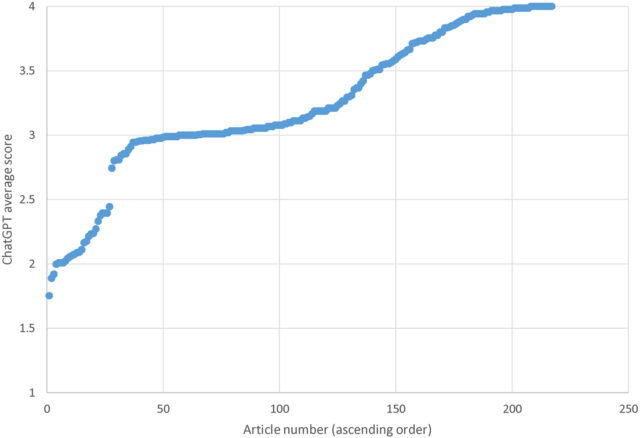

Puntuación promedio de la referencia de chatgpt para los 217 artículos de alto perfil retraído o en relación con los artículos. Los artículos se enumeran en la puntuación de la orden ascendente de ChatGPT. Crédito: Publicación aprendida (2025). Doi: 10.1002/salto.2018

Un nuevo estudio ha examinado cuestiones de modelos de idiomas grandes (LLM) que no marcan los artículos que se han retirado o se desacreditan cuando se les pide que evalúen su calidad.

El nuevo papelEn coautor del profesor Mike Thelwall y el Dr. Irini Katsirea, se presenta en el Learn Publishing Journal, y es el último resultado de un proyecto de investigación titulado “Ciencia poco confiable: desentrañar el impacto de la tergiversación de los principales medios de comunicación”, que comenzó en octubre de 2024.

El equipo de investigación identificó 217 estudios académicos retraídos o “de lo contrario con respecto” con puntajes altétricos altos y le pidió a ChatGPT que evalúe su calidad 30 veces cada una.

Ninguno de los 6.510 informes que el CHATGPT produjo mencionó que los artículos estaban retirados o tenían errores relevantes, y dio 190 de los documentos de puntajes relativamente altos, lo que indica que los artículos eran líderes mundiales, internacionalmente excelentes o similares. Las únicas críticas que ChatGPT niveló en los artículos de menor puntaje pertenecía a su debilidad académica, no su retracción u otros errores, aunque en cinco casos el tema del artículo se describió como “controvertido”.

En una investigación de seguimiento, se extrajeron 61 reclamos de artículos retraídos del set y se le preguntó a ChatGPT 10 veces si cada uno era cierto. Dio un “sí” definitivo o una respuesta positiva dos tercios del tiempo, incluso para al menos una declaración que se había demostrado que era falsa hace más de una década.

El equipo de investigación concluyó que estos hallazgos “enfatizan, desde una perspectiva del conocimiento académico, la importancia de verificar la información de los LLM al usarlos para la búsqueda de información o el análisis”.

El profesor Thelwall dijo: “Los resultados del estudio fueron una sorpresa y la incapacidad de ChatGPT para identificar la investigación retractada es preocupante. Espero que los hallazgos ayuden a aquellos que construyen estos sistemas para mejorarlos. También espero que la investigación brinde una advertencia adicional a los usuarios para evitar confiar en los sistemas de IA generativos, incluso cuando suenan pláusibles e informados”.

Más información: Mike Thelwall et al, ¿Chatgpt ignora las retracciones de los artículos y otras preocupaciones de confiabilidad?, Publicación aprendida (2025). Dos: 10.1002/salto.2018

Proporcionado por la Universidad de Sheffield

Cita: una nueva investigación sugiere que ChatGPT ignora las retracciones y errores del artículo cuando se usa para informar las revisiones de literatura (2025, 5 de agosto) recuperado el 5 de agosto de 2025 de https://techxplore.com/news/2025-08-chatgpt-article-retracciones-errors-literature.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.