Los médicos entienden el potencial transformador de la IA para mejorar la prestación de atención y los resultados de los pacientes, y se dan cuenta de que la promesa requerirá una innovación dirigida por un médico y decisiones reflexivas tomadas hoy para crear el futuro para la medicina que todos queremos.

El impacto de la tecnología de atención médica depende de la confiabilidad de sus sistemas subyacentes, ya sean algoritmos, dispositivos o datos, y cuán cuidadosamente se diseña, implementa e integran. Y para que los médicos adopten la innovación en la atención médica, debe cumplir con cuatro criterios clave:

Efectividad demostrable en entornos clínicos del mundo real; Mostrar un valor claro para los pacientes, los médicos y el sistema de salud más amplio; Asegurar marcos de responsabilidad claros y asignados adecuadamente; Integre a la perfección en los flujos de trabajo clínicos.

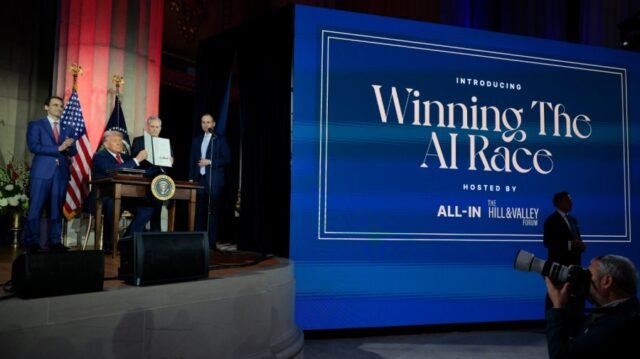

El Plan de acción de IA de la administración TrumpLanzado la semana pasada, es un desarrollo emocionante y bienvenido. Examina mucha atención para construir confianza pública y profesional para la tecnología de IA a través de un exceso transparente y ético y para acelerar los estándares nacionales para la seguridad, el rendimiento y la interoperabilidad.

En la Asociación Médica Americana, también creemos en la importancia de un enfoque regulatorio federal amplio y bien coordinado para el diseño e integración de la IA, y el compromiso de mejorar la fuerza laboral del clínico. Sin embargo, para garantizar que la IA en la atención médica alcance su máximo potencial, la fuerte representación del médico debe estar presente en cada etapa.

Nuestras encuestas sobre sentimientos médicos sobre la inteligencia aumentada en el programa de atención médica creciente entusiasmo Para las aplicaciones de la tecnología en el mundo clínico, especialmente en su potencial para racionalizar los flujos de trabajo y crear mayores eficiencias de práctica. Aún así, dos de cada cinco médicos permanecen igualmente entusiasmados y preocupados por la IA de la salud.

La confianza verdadera, por parte de pacientes y médicos, requiere consideraciones adicionales que pueden mejorar el impacto del plan de acción. Específicamente, cuatro áreas de oportunidad clave incluyen: 1) los médicos deben ser socios completos en cada etapa del ciclo de vida de IA; 2) es necesario un enfoque coordinado y transparente de todo el gobierno; 3) Los datos seguros que están libres de sesgo mejorarán la confianza; y 4) marcos que distribuyen adecuadamente la responsabilidad.

Involucrar a los médicos en cada etapa del ciclo de vida de la IA significa que los médicos son socios completos en diseño, desarrollo, gobernanza, reglamentación, vigilancia posterior al mercado e integración clínica. Los expertos en médicos están calificados exclusivamente para juzgar si una herramienta de IA es válida, se ajusta al nivel de atención y respalda la relación de paciente-físico.

La AI de atención médica es única, ya que sus riesgos para la salud y el bienestar de nuestros pacientes son potencialmente altos. Proporcionar claridad y consistencia para los desarrolladores, despliegadores y usuarios finales, pacientes y médicos, es esencial, y eso solo vendrá de un enfoque general de gubernamental que incluye los estados. Los formuladores de políticas estatales y federales deben trabajar en coordinación para evitar la fragmentación que sofocaría la innovación. Este enfoque priorizará la seguridad, la responsabilidad y la confianza pública en los sistemas de IA.

La confianza en la IA comienza con la confianza en cómo se utilizan los datos. Los médicos y los pacientes necesitan garantías de que las herramientas de IA de alimentación de datos sean seguras, desidentificadas, libres de sesgos y rigadas por marcos de consentimiento sólidos. Necesitamos protecciones integrales de privacidad y estructuras de gobernanza que aseguren que los pacientes comprendan cómo se utilizan sus datos y que puedan controlarlos. Además, el sesgo en la IA puede causar daño real del paciente. Eliminar las referencias a la información errónea o la diversidad, la equidad y la inclusión en los marcos de riesgos pueden dificultar nuestra capacidad de abordar estos problemas. Los esfuerzos para mitigar el sesgo deben seguir siendo una piedra angular de cualquier estrategia ética de IA.

Finalmente, las preocupaciones sobre la responsabilidad de la IA es un problema principal para los médicos. Para generar fideicomiso y adopción anticipada, será imperativo asegurarse de que haya marcos establecidos que protejan a los médicos y distribuyan adecuadamente la responsabilidad por errores de IA y problemas de rendimiento.

La IA no es solo el futuro de la atención médica, es en gran medida el presente. El nuevo plan de acción de IA del gobierno es un paso alentador para llevar algunos de estos problemas a la vanguardia, mientras que la tecnología de salud de IA todavía está en su infancia. Como médicos, tenemos una oportunidad y una responsabilidad de trabajar hoy para garantizar que la IA transforme la atención médica y no solo automatice ineficiencias. Estamos entusiasmados de aprovechar ese impulso y trabajar juntos para crear un futuro donde la innovación mejore cada encuentro de pacientes y aumente la atención de cada médico.

John Whyte, MD, MPH, es CEO y vicepresidente ejecutivo de la Asociación Médica Americana. Margaret Lozovatsky, MD, es la directora de información médica de la AMA y vicepresidenta de innovaciones de salud digital.